ONGs usam imagens de “pobreza” geradas por IA em campanhas e reacendem debate sobre ética e estereótipos

Agências humanitárias estão substituindo retratos reais de vulnerabilidade por fotos sintéticas — mais baratas e carregadas de preconceito visual

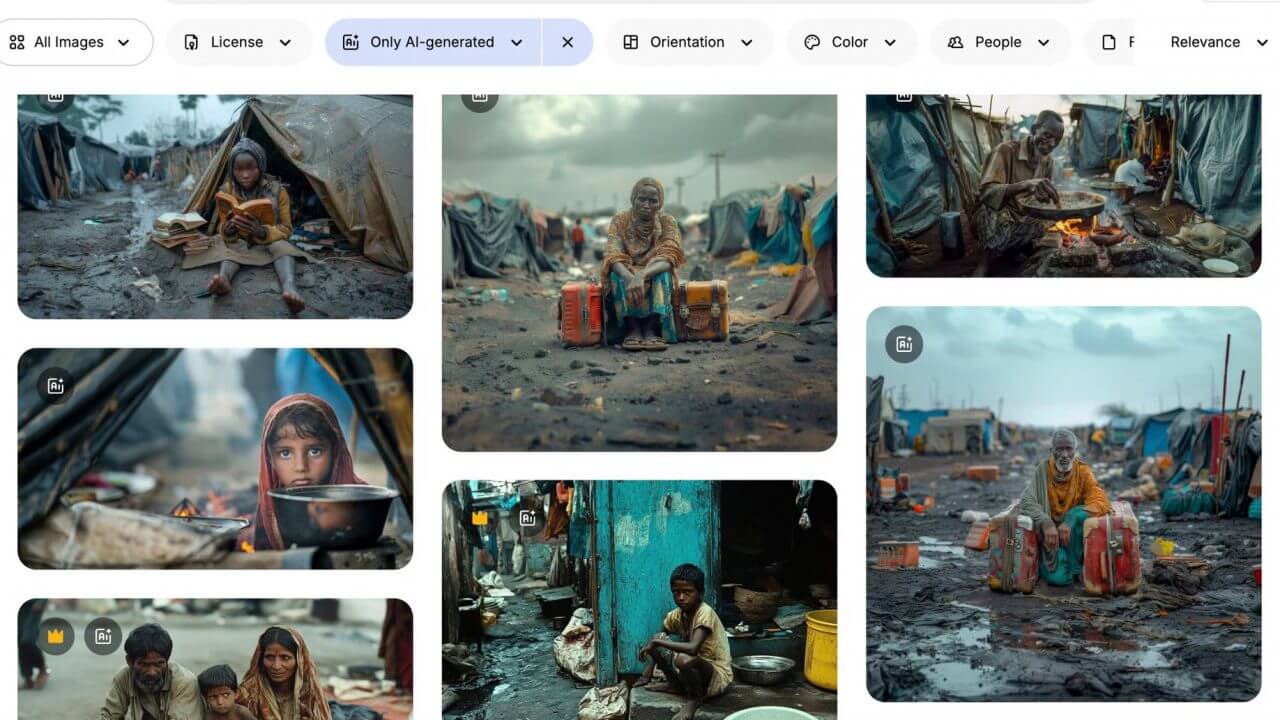

Um levantamento do The Guardian, assinado por Aisha Down, revelou que organizações humanitárias e ONGs globais de saúde estão usando imagens geradas por inteligência artificial para retratar fome, pobreza extrema e violência sexual em campanhas nas redes sociais.

As fotos — muitas delas criadas em bancos de imagem como Freepik e Adobe Stock — mostram crianças com pratos vazios, mulheres em favelas e cenas de sofrimento genérico, sem que haja pessoas reais por trás dos retratos.

Leia também

A prática reacendeu o debate sobre o chamado “poverty porn”, termo usado há décadas para descrever o uso de imagens sensacionalistas da miséria com apelo emocional e estereotipado. Agora, o fenômeno entra em sua nova fase: o “poverty porn 2.0”, sem pessoas reais, mas com a mesma carga de exploração simbólica.

Por que importa: O uso de imagens sintéticas é visto por parte das ONGs como uma forma “segura” e barata de driblar dilemas éticos — especialmente os relacionados a consentimento e privacidade — e cortes de orçamento em campanhas. Mas especialistas alertam que a solução tecnológica pode agravar preconceitos raciais e culturais, além de distorcer a percepção global sobre a pobreza.

“Essas imagens repetem a gramática visual da pobreza: pratos vazios, terra rachada, crianças tristes”, diz o pesquisador Arsenii Alenichev

“Está se tornando comum”, diz Noah Arnold, da Fairpicture, organização suíça que promove práticas éticas de fotografia no setor de desenvolvimento. “Muitos já estão testando imagens feitas por IA. É barato, rápido e não exige consentimento.”

O pesquisador Arsenii Alenichev, do Instituto de Tropical Medicine de Antuérpia, coletou mais de 100 exemplos de imagens sintéticas usadas por ONGs e indivíduos. Segundo ele, as fotos “replicam a gramática visual da pobreza”, com enquadramentos e estereótipos herdados da fotografia humanitária tradicional.

Em um artigo publicado na Lancet Global Health, Alenichev argumenta que essas representações “transformam o sofrimento em estética” e criam uma nova forma de exploração — “pornografia da pobreza” adaptada à era da IA.

Os novos rostos da miséria (sem rostos reais)

As imagens, disponíveis em bancos públicos, vêm acompanhadas de legendas genéricas como “criança fotorealista em campo de refugiados” ou “voluntário branco oferece consulta médica a crianças africanas”. Duas dessas imagens estão à venda na Adobe Stock por cerca de £60.

“São fotos racializadas e estereotipadas. Nunca deveriam ter sido publicadas”, diz Alenichev.

A responsabilidade (ou a falta dela)

O CEO da Freepik, Joaquín Abela, declarou que a responsabilidade pelas imagens “é dos consumidores, não das plataformas”. Segundo ele, a empresa tenta “injetar diversidade” em fotos corporativas, mas admite que o controle sobre conteúdo gerado por usuários é limitado.

“É como tentar secar o oceano”, afirmou. “Se o público quer imagens de um certo tipo, não há muito o que fazer.”

O problema, alertam especialistas, é que essas imagens tendem a se espalhar pela internet e voltar ao ciclo de treinamento de IA, amplificando preconceitos e reforçando a visão colonial de países pobres como espaços de sofrimento e carência.

Casos emblemáticos

O uso de IA não é novo em campanhas de ajuda humanitária.

Em 2023, o braço holandês da Plan International lançou um vídeo contra o casamento infantil com imagens geradas por IA, mostrando uma menina com o olho roxo e um homem mais velho. No ano seguinte, a ONU publicou um vídeo com “reencenações” de violência sexual em zonas de conflito, incluindo o depoimento sintético de uma mulher burundiana.

O avanço da IA no setor de ajuda humanitária expõe um paradoxo. Para evitar explorar pessoas reais, as ONGs estão criando personagens que nunca existiram, mas que carregam as mesmas narrativas de miséria e exotização. A ética se esvazia quando o problema deixa de ser o rosto e passa a ser o olhar.

A real: a IA promete neutralidade, mas aprende com os mesmos preconceitos que já moldam o olhar ocidental sobre a pobreza. Trocar fotos reais por imagens sintéticas não elimina a exploração — só a torna mais polida.

Comentários

Sua voz importa aqui no B9! Convidamos você a compartilhar suas opiniões e experiências na seção de comentários abaixo. Antes de mergulhar na conversa, por favor, dê uma olhada nas nossas Regras de Conduta para garantir que nosso espaço continue sendo acolhedor e respeitoso para todos.